Microsoft vs AWS - Mistral Forge - Emplois en France - MCP et A2A rivalisent - L'adoption décline...

NL°11 - Cap rentabilité B2B pour OpenAI; Plus d'infra et moins de jobs pour Meta; Context Graph pour les agents; Pari LLM de LinkedIn; Le droit d'auteur sanctuarisé face à l'IA; Stargate plombé...

Actualités IA & Data

L’affrontement Microsoft-Amazon pour l’exclusivité d’Azure

Microsoft étudie une action en justice concernant l’accord de 50 milliards de dollars liant OpenAI à Amazon. Le litige porte sur le “Stateful Runtime Environment” (SRE), une architecture sur AWS Bedrock permettant de gérer des agents autonomes avec mémoire d’état. OpenAI tente ainsi de distinguer ces flux des requêtes « stateless », seules soumises à l’exclusivité d’Azure. Microsoft rejette cette segmentation, affirmant qu’il est « techniquement impossible de se passer d’Azure » pour les infrastructures de cette dimension. Ce conflit menace le déploiement de la plateforme « Frontier » sur AWS et marque une rupture dans l’alliance historique de Redmond. L’enjeu technique réside dans la persistance des données, transformant un partenaire de calcul en un adversaire juridique potentiel sur le marché du cloud.

Lire l’article Guerre du Cloud : Microsoft menace OpenAI de poursuites après son deal avec Amazon

OpenAI : Le pivot vers la rentabilité B2B

Sous la direction de Fidji Simo, OpenAI recentre ses ressources sur la productivité en entreprise pour répondre à la croissance d’Anthropic. La firme suspend ses « quêtes secondaires », incluant le générateur vidéo Sora et le navigateur Atlas, afin de rationaliser sa puissance de calcul. Ce virage stratégique vise à transformer ChatGPT en un outil indispensable pour les professionnels via GPT 5.4 et Codex. OpenAI profite de la désignation d’Anthropic comme risque pour la chaîne d’approvisionnement par le Pentagone pour renforcer sa position institutionnelle. Ce cadre opérationnel prépare une introduction en bourse envisagée pour le « quatrième trimestre 2026 ». La priorité est désormais la validation d’un modèle économique capable de générer des revenus solides.

Lire l’article OpenAI : le virage vers le B2B pour contrer l’ascension d’Anthropic

Microsoft : Unification Copilot et mise à l’écart de Mustafa Suleyman

Satya Nadella a annoncé l’unification des équipes Copilot professionnelles et grand public sous la direction de Jacob Andreou. Cette réorganisation écarte Mustafa Suleyman des responsabilités opérationnelles, ce dernier se consacrant désormais à la « superintelligence ». Ce mouvement fait suite à une adoption de M365 Copilot jugée lente, avec 15 millions d’utilisateurs annuels malgré l’intégration système. Microsoft cherche à bâtir un « système véritablement intégré » pour contrer l’influence de Google Gemini et Anthropic Cowork. Le remplacement des structures silotées par un effort unifié témoigne d’une urgence à prouver la pertinence de l’assistant IA. Cette crise interne souligne les difficultés de Redmond à s’imposer durablement sur le segment logiciel d’entreprise face aux concurrents spécialisés.

Lire l’article Crise en cours chez Microsoft : les équipes Copilot fusionnent, son responsable de l’IA Mustafa Suleyman écarté

Meta : Réduction d’effectifs pour l’investissement massif

Meta Platforms prévoit de supprimer 20% de ses effectifs mondiaux afin de dégager 6 milliards de dollars d’économies annuelles. Ces fonds soutiendront un plan d’investissement de 135 milliards de dollars dédié à l’IA. Mark Zuckerberg privilégie désormais le capital technologique au capital humain pour maintenir la rentabilité du groupe. Une part du budget est allouée à des prestataires externes, dont un contrat de 27 milliards de dollars avec le fournisseur Nebius. Cette mutation intervient alors que le modèle interne « Avocado » affiche des résultats en deçà des attentes. La stratégie comptable vise à rattraper le retard accumulé sur OpenAI et Google en doublant les dépenses en infrastructures physiques et en puissance de calcul.

Lire l’article Meta : le grand basculement vers l’IA se fera au prix de 20 % de ses effectifs

Mistral Forge : L’alternative souveraine personnalisable

Mistral AI a lancé la plateforme Forge pour permettre la création de modèles personnalisés adaptés aux secteurs réglementés comme la Défense. Cet outil gère l’intégralité du cycle de vie des modèles, du pré-entraînement en Mixture-of-Experts à l’inférence sur infrastructures propres. Le fournisseur français a également introduit Small 4, annoncé comme « 40% plus rapide que son prédécesseur », et Leanstral pour le code. En rejoignant le consortium Nemotron de Nvidia, Mistral AI s’intègre à l’écosystème mondial tout en garantissant le contrôle des données. Cette stratégie cible les organisations soucieuses de conformité, offrant une flexibilité multimodale sur Mistral Compute ou serveurs privés. L’objectif est de fournir des agents spécifiques sans construire de modèle de base à partir de zéro.

Lire l’article Avec Forge, Mistral AI personnalise les modèles IA des entreprises

Context Graph : La capture du raisonnement décisionnel

Le concept de « Context Graph » vise à doter les agents IA d’une mémoire procédurale capturant le « pourquoi » des décisions. Contrairement aux graphes de connaissances classiques, cette structure documente l’historique et les précédents pour assurer la conformité des actions automatisées. Jésus Barrasa, de Neo4j, précise que l’objectif est de rendre ces traces décisionnelles consultables. Cependant, des analystes comme Esteban Kolski qualifient le terme d’« aberration marketing », craignant une confusion avec le contexte des modèles de langage. Malgré les doutes, des entreprises expérimentent l’intégration de ces graphes dès la conception des agents pour stabiliser leurs processus. Cette approche reste complexe à appliquer aux environnements existants où la collecte de données éparses demeure une tâche délicate.

Lire l’article Context Graph : le nouveau Graal de l’IA agentique à la loupe

Pas d’assouplissement du droits d’auteur au bénéfice de l’IA

Le gouvernement britannique a renoncé à assouplir le droit d’auteur pour l’entraînement des modèles d’IA suite à l’opposition de 400 artistes. Elton John et Paul McCartney ont mené cette mobilisation contre une exception législative qui aurait permis d’utiliser des contenus sans autorisation ni rémunération. La ministre Liz Kendall a déclaré que cette mesure « n’est plus la piste privilégiée par le gouvernement » après avoir été rejetée par les industries créatives. Cette décision souligne la résistance du secteur culturel face à l’exploitation commerciale non consentie de ses œuvres. Le retrait du texte marque un point d’arrêt pour les entreprises technologiques cherchant à faciliter l’accès aux données d’entraînement. La protection des droits reste un obstacle juridique majeur pour le développement des modèles de base.

Lire l’article Droits d’auteur : Elton John et Paul McCartney gagnent une bataille face à l’IA

Réussir dans l’IA

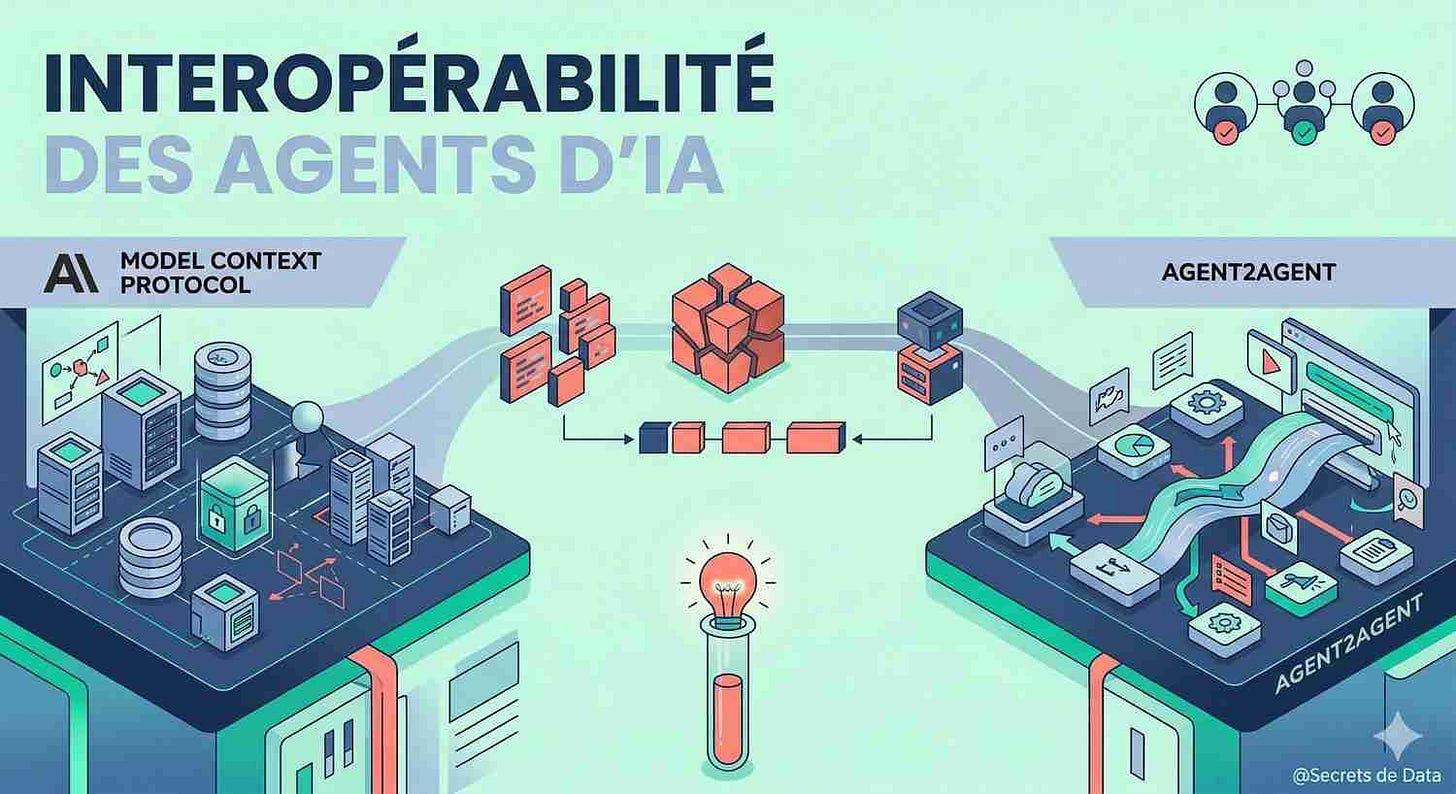

Interopérabilité : L’affrontement des protocoles MCP et A2A

L’IA agentique souffre d’une fragmentation technique limitant la collaboration entre systèmes autonomes. Deux protocoles émergent : le Model Context Protocol (MCP) d’Anthropic pour les périmètres de confiance, et l’Agent2Agent (A2A) de Google pour la coordination des tâches. L’absence d’une couche de données partagée oblige les responsables IT à privilégier des architectures modulaires. Steve Wilson note que MCP perdrait en popularité en raison d’une architecture serveur jugée complexe par les développeurs. Jim Swanson, DSI de Johnson & Johnson, recommande une expérimentation volontariste pour éviter d’être distancé par l’innovation. La consolidation des standards devrait être plus rapide que celle du protocole TCP/IP, car l’industrie cherche urgemment à unifier l’identité et la cohérence des agents.

Lire l’article Agents IA : comment gérer le casse-tête de l’interoperabilité (en attendant la standardisation)

Le pari à 1,3 milliard d’utilisateurs de LinkedIn

LinkedIn a remplacé cinq pipelines de recommandation par un système unique basé sur un modèle de langage à grande échelle. Cette unification traite les interactions des membres comme une « séquence narrative » pour améliorer la personnalisation du flux. Pour intégrer les signaux de popularité, les ingénieurs ont converti les nombres de vues en « percentile buckets » encapsulés dans des jetons spécifiques. La gestion des coûts a imposé une séparation stricte entre le traitement CPU et l’inférence GPU. L’utilisation d’un modèle de recommandation génératif permet désormais d’analyser plus de mille interactions historiques par utilisateur. Ce projet démontre que le déploiement de l’IA à cette échelle nécessite de repenser la structure des données pour les rendre intelligibles par les modèles.

Lire l’article How LinkedIn replaced five feed retrieval systems with one LLM model, at 1.3 billion-user scale

Le succès de l’hybridation pour autonomiser les métiers

Eiffage, MGEN et TotalEnergies privilégient une organisation hybride pour décentraliser l’expertise IA vers les directions métiers. La DSI évolue vers un rôle de facilitateur, fournissant des « Data Products » qui masquent la complexité technique aux analystes locaux. L’autonomie est conditionnée par l’obtention d’un « permis IA », une formation obligatoire de moins de deux heures pour prévenir les risques d’hallucination. Chez Eiffage, l’outil est comparé à une « voiture de course » exigeant une maîtrise minimale pour éviter de « aller dans le mur ». La stratégie repose sur la responsabilité des métiers vis-à-vis de leurs propres données et une gestion du temps libéré. L’objectif est d’augmenter le travail humain sans surcharge cognitive, en intégrant la donnée comme une compétence transverse durable.

Lire l’article Data & IA pour les métiers chez Eiffage, MGEN, Etam et TotalEnergies

ROI : Les indicateurs de performance en jetons

Environ 56% des PDG ne constatent aucun impact financier direct de l’IA sur leurs revenus ou leurs coûts de fonctionnement. Shamim Mohammad, de CarMax, note une « incompréhension fondamentale » des mesures de performance, trop centrées sur la productivité individuelle. Pour générer de la valeur, les projets doivent s’aligner sur des objectifs stratégiques comme l’optimisation du capital ou l’expérience client. La réussite se mesure désormais « en jetons plutôt qu’en minutes », intégrant la volatilité des coûts d’exploitation des modèles. Les experts recommandent d’évaluer le retour sur investissement à l’échelle d’un portefeuille de projets plutôt que de cas isolés. Les gains réels proviennent de transformations majeures dans la chaîne d’approvisionnement ou la gestion du cycle de vie des contrats.

Lire l’article Cinq conseils pour réussir des projets IA à coût maîtrisé

Cybersécurité : L’industrialisation de la persuasion

L’intelligence artificielle industrialise les attaques existantes en provoquant une « contraction du temps entre opportunité et exploitation ». Le phishing personnalisé et le clonage vocal deviennent accessibles grâce à des écosystèmes criminels dédiés à la persuasion. Vincent Nguyen, de Stoïk, note que le texte est devenu un vecteur d’injection comparable aux injections SQL pour les systèmes autonomes. La défense doit s’appuyer sur des « guardrails explicites » définissant les limites d’action des agents et imposant une validation humaine pour les flux financiers. Il est nécessaire de traiter chaque modèle comme un binaire potentiellement hostile dont il faut vérifier la provenance et l’intégrité. La sécurité symbiotique repose sur une répartition des rôles où l’IA assure la surveillance continue tandis que l’humain définit le cadre.

Lire l’article Cybermenaces pilotées par l’IA : quelle stratégie de défense ?

Les chiffres de l’IA

Emploi : La réalité de la réallocation stratégique

Le concept de « Job Apocalypse » est tempéré par des données montrant que 79% des départs au premier semestre 2025 n’étaient pas liés à l’IA. Les licenciements dans la tech correspondent souvent à une volonté d’améliorer les finances au profit d’investissements massifs dans l’infrastructure. Ce mouvement constitue les signes d’une « réallocation stratégique » visant à modifier les processus plutôt qu’à supprimer les fonctions humaines. L’enjeu est de repositionner les forces de travail vers des tâches à haute valeur ajoutée. L’automatisation permet de libérer du temps de développement pour produire plus à coût équivalent, sans nécessairement réduire les effectifs. La mutation exige une révision des plans de gestion des emplois pour accompagner les talents vers l’augmentation humaine par les agents intelligents.

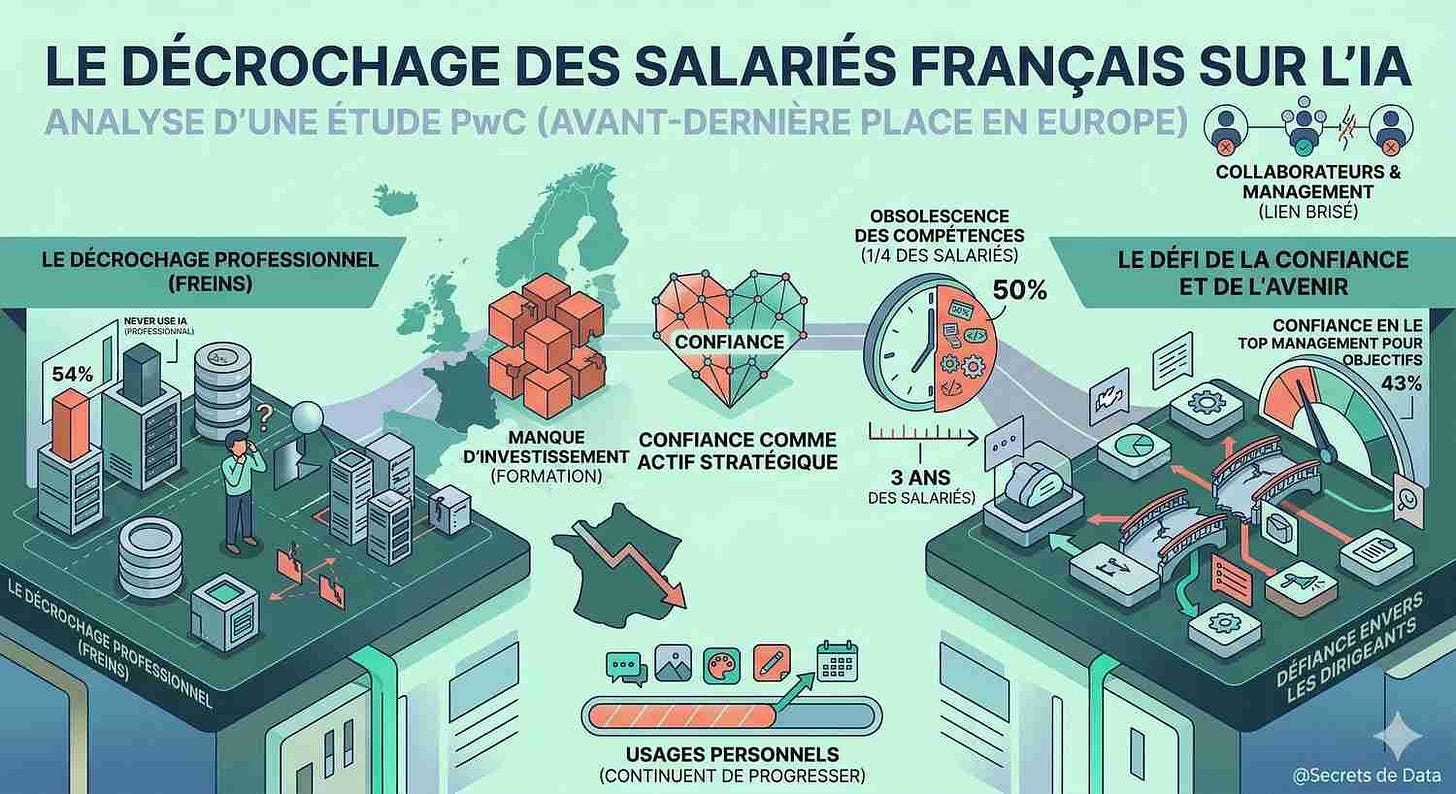

Le décrochage des salariés français sur l’IA

Une étude de PwC révèle que 54% des actifs français n’utilisent jamais l’IA, plaçant l’Hexagone à l’avant-dernière place en Europe. Ce ralentissement professionnel s’explique par un manque de cadre structurant et une défiance envers les dirigeants. Seuls 43% des collaborateurs disent avoir confiance en leur top management pour atteindre les objectifs fixés. Un quart des salariés français estime que la moitié de leurs compétences actuelles seront obsolètes d’ici 3 ans. Le déploiement de la technologie s’essouffle faute d’investissements suffisants dans la formation et l’accompagnement managérial. La confiance est désormais un actif stratégique à construire, alors que les usages personnels de l’IA continuent de progresser en dehors du cadre de l’entreprise.

Lire l’article Pour la première fois, l’usage de l’IA recule en entreprise : plus de la moitié des salariés français ne l’utilisent pas

Risques : 5 millions de postes exposés en France

Selon la Coface, un emploi sur six en France est menacé par l’automatisation, particulièrement dans les secteurs de l’informatique et du juridique. Ces postes à risque sont concentrés dans les grandes métropoles et touchent les niveaux de qualification supérieurs et les « métiers les mieux rémunérés ». À l’inverse, les activités physiques comme le nettoyage ou la restauration affichent une exposition inférieure à 8%. L’étude indique que plus un métier s’exerce derrière un écran, plus il est vulnérable à l’IA d’ici deux à cinq ans. Les 10% des Français aux revenus les plus élevés sont menacés à hauteur de 22,1%. Cette polarisation de la menace impose une vigilance sur la transformation des tâches de production d’information au sein des sièges sociaux.

Lire l’article Cinq millions d’emplois, soit un sur six, sont menacés par l’intelligence artificielle en France

Stargate : Le retrait stratégique du site d’Abilene

OpenAI et Oracle ont annulé leur implantation sur le campus d’Abilene au Texas, initialement destiné à la mégaconstellation Stargate. Ce site, prévu pour atteindre 2 GW de puissance, sera finalement repris par Microsoft pour Azure. Les frictions entre OpenAI et la société Crusoe, liées à des défaillances de refroidissement par grand froid, expliquent ce désengagement. OpenAI maintient un objectif de chiffre d’affaires de 280 milliards de dollars sous quatre ans, nécessitant une infrastructure de 38 GW. Cette ambition dépasse largement la capacité actuelle des centres de données américains, limitée à 15 GW. La start-up envisage désormais l’installation de serveurs propres en Europe via Nscale pour réduire ses frais d’hébergement.

Lire l’article IA américaine : Stargate abandonne son premier datacenter

Voix de l’IA

Nvidia : La domination de la baie de serveurs

Jensen Huang ambitionne de posséder l’intégralité du centre de données via des solutions intégrées de bout en bout. La baie LPX, dédiée à l’inférence, utilise des puces conçues sous une licence de 20 milliards de dollars auprès de la startup Groq. Cette technologie LPU permet une consommation par bit d’accès mémoire « 20 fois moindre » que celle d’un GPU standard. En associant les processeurs Vera et Rubin, Nvidia propose une infrastructure capable de multiplier par dix les revenus par mégawatt consommé. Cette stratégie de co-conception vise à remplacer les architectures x86 d’Intel et AMD par une offre multicouche optimisée. L’objectif est de fournir une valeur maximale pour toutes les charges de travail de l’IA, de la compilation de code aux requêtes SQL.

Lire l’article Comment Nvidia veut posséder votre centre de données d’IA de bout en bout

HPE : Les centres de données modulaires en kit

HPE déploie des centres de données de 12 mètres permettant une mise en service en sept mois, contre trois ans traditionnellement. Ces unités utilisent le refroidissement liquide direct (DLC) pour atteindre un indice d’efficacité énergétique (PUE) de 1,08. Le ministère des Armées a adopté cette solution pour le supercalculateur « Asgard », installé sur un terrain exigu au mont-Valérien. Ces modules supportent des puissances allant jusqu’à 1,6 mégawatt et fonctionnent comme un « jeu de Lego » évolutif. L’Agence spatiale européenne utilise également ces infrastructures à Frascati pour ses besoins en calcul haute performance. Cette approche réduit les délais de construction en menant la fabrication des conteneurs et la préparation des sites en parallèle, tout en permettant la réutilisation de la chaleur.

Lire l’article Rapidité de déploiement, gain de place, efficacité énergétique : HPE mise activement sur les data centers modulaires conçus pour l’IA

Mistral et Reply : L’offensive européenne régulée

Mistral AI s’est associé à Reply pour accélérer l’adoption de l’IA souveraine au sein des administrations et de la santé en Europe. Ce partenariat garantit le respect des cadres réglementaires locaux et le contrôle des données sensibles sur des infrastructures européennes. L’Académie autrichienne des sciences constitue le premier utilisateur de Mistral Forge pour créer un modèle de langage dédié au grec ancien et moderne. Le projet s’appuie sur un corpus spécialisé incluant des papyri numérisés et de la littérature académique. Cette collaboration démontre la capacité de Mistral AI à traiter des domaines hautement réglementés via des intégrateurs capables de personnaliser les modèles. L’initiative vise à offrir une alternative aux solutions généralistes américaines pour les institutions exigeant une précision sectorielle.

Lire l’article Comment Mistral AI s’installe durablement dans le paysage de l’IA avec la capacité à opérer dans des secteurs hautement réglementés

Oracle : Une croissance financée par la dette

Les revenus d’Oracle Cloud Infrastructure (OCI) progressent de 84%, portés par la technologie RDMA qui facilite l’entraînement de modèles sur des clusters de 100 000 GPU. Malgré ce résultat, le flux de trésorerie disponible s’établit à -24,7 milliards de dollars sur les douze derniers mois. L’entreprise finance l’expansion de ses capacités par l’endettement pour honorer un carnet de commandes de 553 milliards de dollars. La dépendance envers OpenAI est marquée, ce client représentant environ 300 milliards de dollars du backlog total. Oracle mise sur la conversion de cette demande en revenus récurrents d’ici 2027 pour stabiliser son bilan financier et atteindre une valorisation d’un millier de milliards de dollars.

Lire l’article Oracle 2026 : Le pari colossal de l’infrastructure IA face au mur du cash-flow